Instagram va flouter les nus dans les messages envoyés aux mineurs

Instagram se prépare à déployer une nouvelle fonctionnalité de sécurité qui brouille les images de nus dans les messages, dans le cadre des efforts visant à protéger les mineurs de la plateforme contre les abus et les escroqueries à caractère d'exploitation sexuelle.

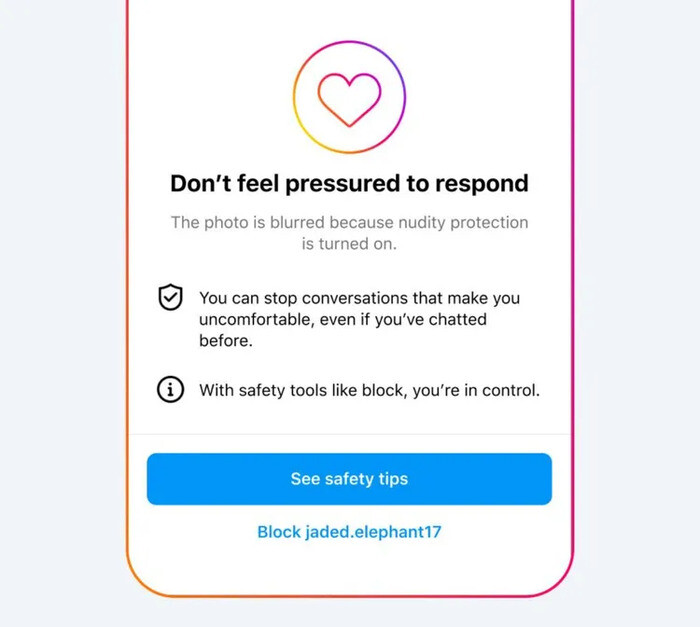

Annoncée par Meta ce jeudi 11 avril 2024, la nouvelle fonctionnalité – qui brouille les images détectées comme contenant de la nudité et décourage les utilisateurs de les envoyer – sera activée par défaut pour les utilisateurs adolescents d'Instagram, identifiés par les informations d'anniversaire sur leur compte. Une notification encouragera également les utilisateurs adultes à l'activer.

Ces efforts font suite à des critiques de longue date selon lesquelles des plateformes comme Facebook et Instagram ont causé du tort à leurs plus jeunes utilisateurs, allant de la santé mentale et de l'image corporelle des enfants à la plateforme délibérée de parents violents et à la création d'un «marché pour les prédateurs à la recherche d'enfants».

La nouvelle fonctionnalité sera testée dans les semaines à venir selon le Wall Street Journal, avec un déploiement mondial attendu au cours des prochains mois. Meta affirme que la fonctionnalité utilise l'apprentissage automatique sur l'appareil pour analyser si une image envoyée via le service de messagerie directe d'Instagram contient de la nudité et que l'entreprise n'aura pas accès à ces images à moins qu'elles n'aient été signalées.

Lorsque la protection est activée, les utilisateurs d'Instagram qui reçoivent des photos de nus recevront un message leur indiquant de ne pas se sentir obligés de répondre, ainsi que des options pour bloquer et signaler l'expéditeur. Les utilisateurs qui tentent d'envoyer une photo nue verront également un message les avertissant des dangers liés au partage de photos sensibles, tandis qu'un autre message d'avertissement découragera les utilisateurs qui tentent de transmettre une image nue qu'ils ont reçue.

Il s'agit de la dernière tentative de Meta visant à renforcer la protection des enfants sur ses plateformes, après avoir soutenu un outil permettant de mettre hors ligne des images sexuellement explicites de mineurs en février 2023 et de restreindre leur accès à des sujets préjudiciables comme le suicide, l'automutilation et les troubles de l'alimentation plus tôt cette année.

- Vues : 769